主な機能

意思決定に必要な要素を、最短距離で把握できます。

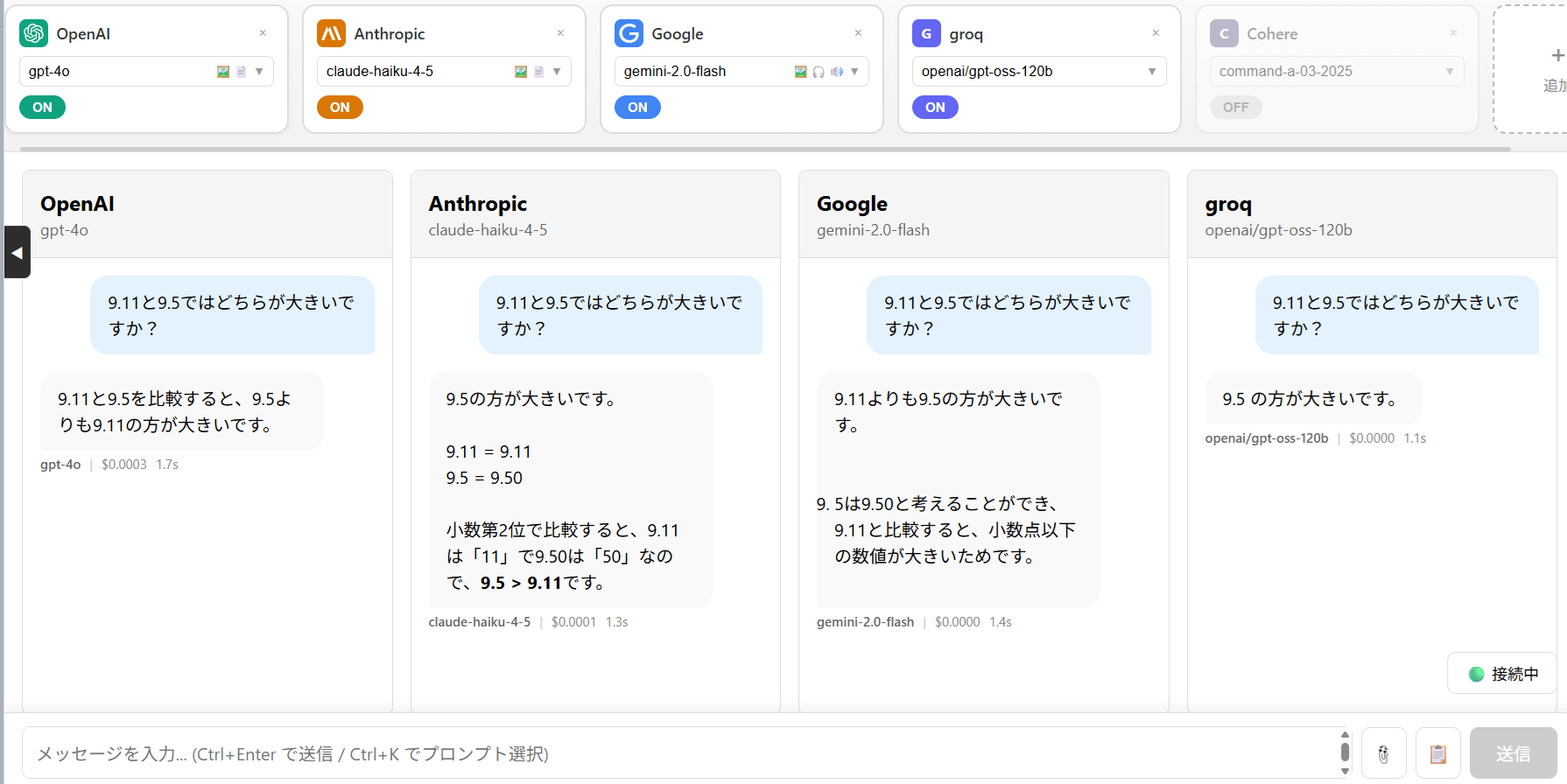

リアルタイム並行比較

複数のLLMが同時に回答を生成。プロバイダーの追加・削除で比較対象を自由にカスタマイズ。一画面で回答品質・速度・コストを比較できます。

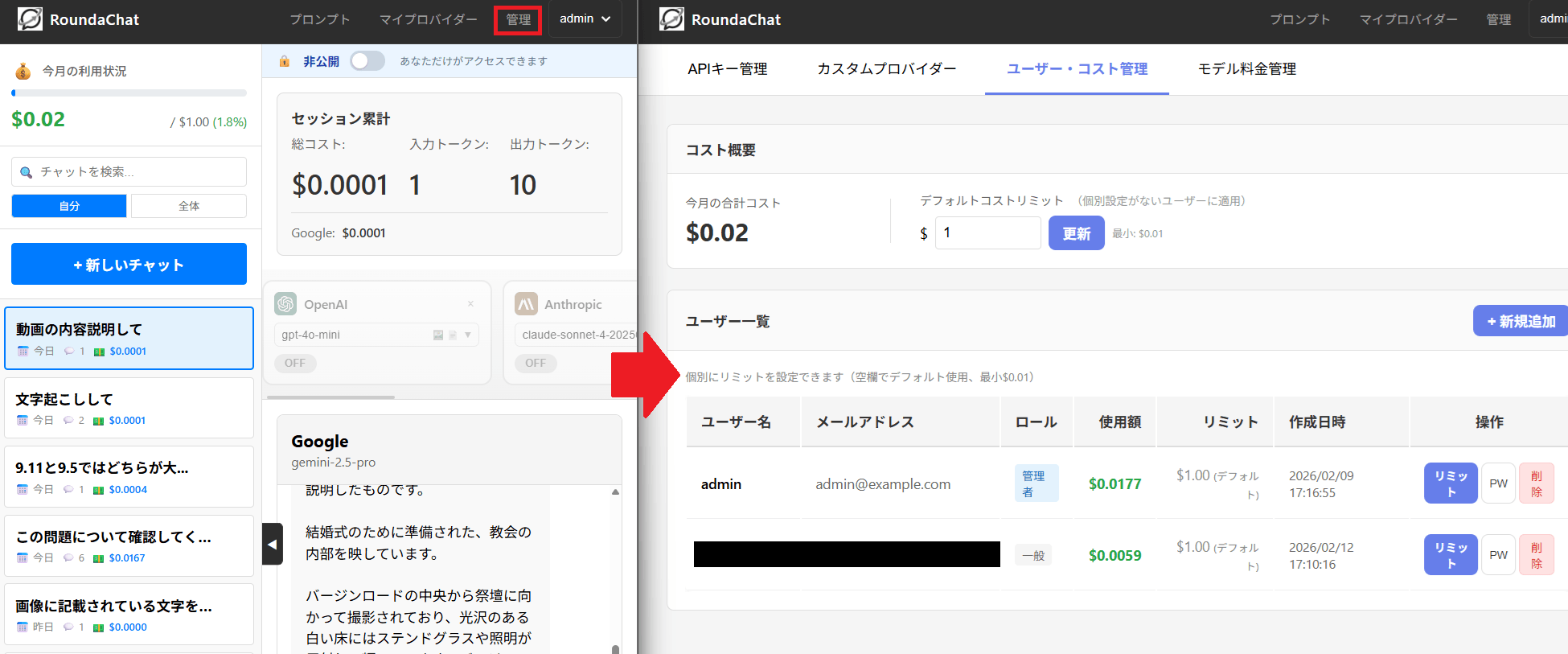

リアルタイムコスト可視化

1回答ごとのトークン数・コスト・レイテンシを自動表示。セッション累計やユーザーごとの利用上限設定にも対応し、費用対効果を数字で社内説明できます。

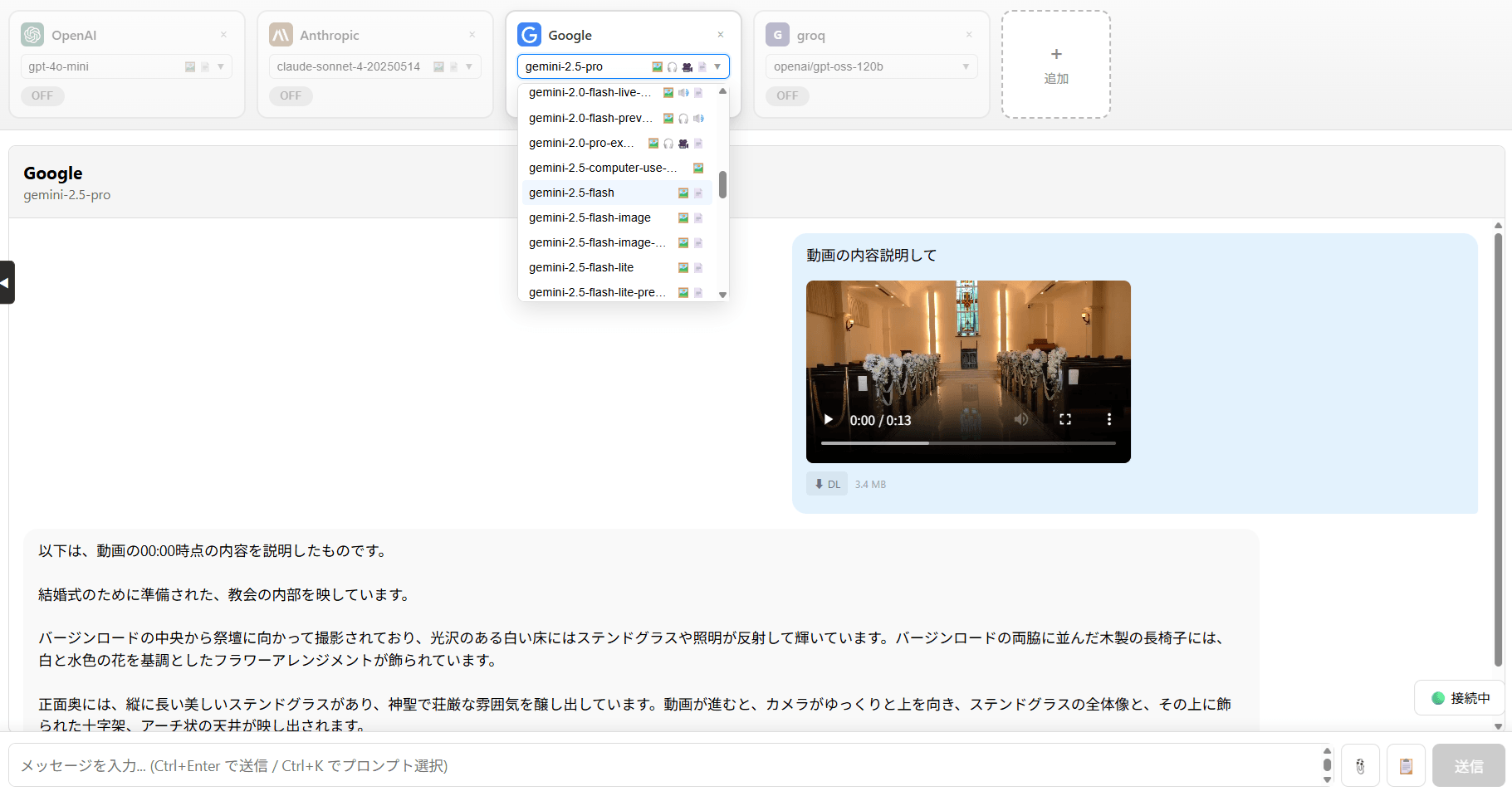

マルチモーダル入力対応

テキストだけでなく、画像・PDF・音声・動画・Officeファイルを入力可能。各モデルの対応状況をモダリティバッジで一目で確認できます。